2.WebMagic详解

[toc]

WebMagic详解

1. WebMagic介绍

昨天完成了爬虫的入门的学习,是一个最基木的爬虫案例,今天我们要学习一款爬虫框架的使用就是WebMagic。其底层用到了我们上一天课程所使用的HttpClient和 Jsoup,让我们能够更方便的开发爬虫。

WebMagic项目代码分为核心和扩展两部分。核心部分(webmagic-core)是一个精简的、模块化的爬虫实现,而扩展部分则包括一些便利的、实用性的功能。

WebMagic的设计目标是尽量的模块化,并体现爬虫的功能特点。这部分提供非常简单、灵活的API,在基木不改变开发模式的情况下,编写一个爬虫。

扩展部分(webmagic-extension)提供一些便捷的功能,例如注解模式编写爬虫等。同时内置了一些常用的组件,便于爬虫开发。

1.1 架构介绍

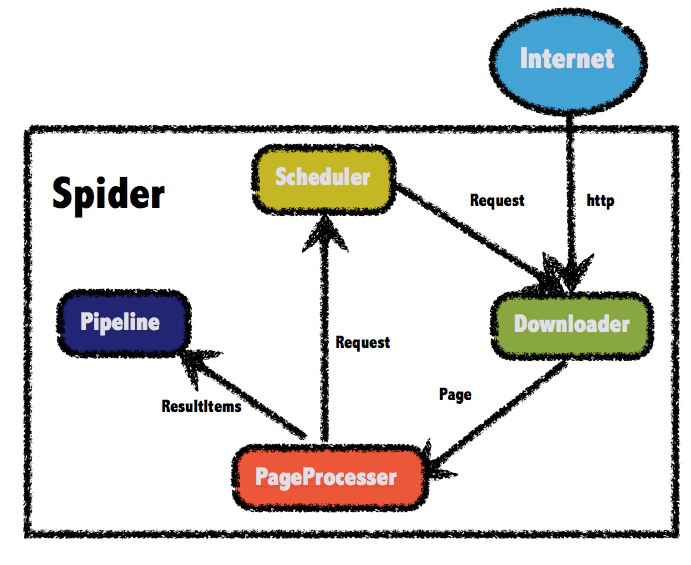

WebMagic的结构分为Downloader、PageProcessor、Scheduler、Pipeline四大组件,并由Spider将它们彼此组织起来。这四大组件对应爬虫生命周期中的下载、处理、管理和持久化等功能。WebMagic的设计参考了Scapy,但是实现方式更Java化一些。

而Spider则将这几个组件组织起来,让它们可以互相交互,流程化的执行,可以认为Spider是一个大的容器,它也是WebMagic逻辑的核心。

WebMagic总体架构图如下:

WebMagic的四个组件

- Downloader

- Downloader负责从互联网上下载页面,以便后续处理。WebMagic默认使用了Apache HttpClient作为下载工具。

- PageProcessor

- PageProcessor负责解析页面,抽取有用信息,以及发现新的链接。WebMagic使用Jsoup作为HTML解析工具,并基于其开发了解析XPath的工具Xsoup。

- 在这四个组件中,PageProcessor对于每个站点每个页面都不一样,是需要使用者定制的部分。

- Scheduler

- Scheduler负责管理待抓取的URL,以及一些去重的工作。WebMagic默认提供了

JDK的内存队列来管理URL,并用集合来进行去重。也支持使用Redis进行分布式管理。

- Scheduler负责管理待抓取的URL,以及一些去重的工作。WebMagic默认提供了

- Pipeline

- Pipeline负责抽取结果的处理,包括计算、持久化到文件、数据库等。WebMagic默认提供了“输出到控制台”和“保存到文件”两种结果处理方案。

- Pipeline定义了结果保存的方式,如果你要保存到指定数据库,则需要编写对应的Pipeline。对于一类需求一般只需编写一个Pipeline。

用于数据流传的对象

- Request

- Request是对URL地址的一层封装,一个Request对应一个URL地址。

- 它是PageProcessor与Downloader交互的载体,也是PageProcessor控制Downloader唯一方式。

- 除了URL本身外,它还包含一个Key-Value结构的字段extra。你可以在extra中保存一些特殊的属性,然后在其他地方读取,以完成不同的功能。例如附加上一个页面的一些信息等。

- Page

- Page代表了从Downloader下载到的一个页面——可能是HTML,也可能是JSON或者其他文本格式的内容。

- Page是WebMagic抽取过程的核心对象,它提供一些方法可供抽取、结果保存等。

- ResultItems

- ResultItems相当于一个Map,它保存PageProcessor处理的结果,供Pipeline使用。它的API与Map很类似,值得注意的是它一个字段skip,若设置为true,则不应被Pipeline处理。

1.2 入门案例

创建maven工程itbuild-crawler-webmagic

添加依赖

1 | <dependencies> |

加入配置文件

WebMagic内置使用 slf4j-log4j12 作为 slf4j 的实现。

在resources目录添加 log4j.properties 配置文件

1 | log4j.rootLogger=INFO,A1 |

案例实现

1 | package cn.itbuild.webmagic.test; |

2. WebMagic 功能

2.1 实现PageProcessor

抽取元素 Selectable

WebMagic里主要使用了三种抽取技术:XPath、正则表达式和 CSS选择器。另外,对于JSON格式的内容,可使用JsonPath进行解析。

- XPath,使用路径表达式来选取 XML 文档中的节点或节点集。

- CSS选择器 (同JQuery选择器用法)

- 可是使用

:nth-child(n)选择第几个元素。

- 可是使用

- 正则表达式,是一种通用的文本抽取语言一般用于获取url地址。

抽取元素API

Selectable相关的抽取元素链式API是 WebMagic的一个核心功能。使用Selectable接口,可以直接完成页而元素的链式抽取,也无需去关心抽取的细节。

在刚才的例子中可以看到,page.getHtml()返回的是一个 Html对象,它实现Selectable接口。这个接口包含的方法分为两类:抽取部分和获取结果部分。

| 方法 | 说明 | 示例 |

|---|---|---|

| xpath(String xpath) | 使用XPath选择 | html.xpath("//div[@class='title']") |

| $(String selector) | 使用CSS选择器选择 | html.$("div.title") |

| $(String selector,String attr) | 使用CSS选择器选择 | html.$("div.title","text") |

| css(String selector) | 功能同$(),使用CSS选择器选择 |

html.css("div.title") |

links() |

选择所有链接 |

html.links() |

| regex(String regex) | 使用正则表达式抽取 | html.regex("(.*?)") |

这部分抽取API返回的都是一个selectable接口,意思是说,是支持链式调用的。

获取结果API

当链式调用结束时,我们一般都想要拿到一个字符串类型的结果。这时候就需要用到获取结果的API了。

我们知道,一条抽取规则,无论是xPath、CSS选择器或者正则表达式,总有可能抽取到多条元素。WebMagic对这些进行了统一,可以通过不同的API获取到一个或者多个元素。

| 方法 | 说明 | 示例 |

|---|---|---|

| get() | 返回一条String类型的结果 | String link = html.links().get() |

| toString() | 同get(),返回一条 String类型的结果 | String link = html.links().toString() |

| all() | 返回所有抽取结果。 | List links = html.links().all() |

获取链接

有了处理页面的逻辑,我们的爬虫就接近完工了,但是现在还有一个问题:一个站点的页面是很多的,一开始我们不可能全部列举出来,于是如何发现后续的链接,是一个爬虫不可缺少的一部分。

1 | package cn.itbuild.webmagic.test; |

2.2 使用Pipeline保存结果

WebMagic用于保存结果的组件叫做Pipeline。我们现在通过“控制台输出结果”这件事也是通过一个内置的Pipeline完成的,它叫做ConsolePipeline。

那么,我现在想要把结果用保存到文件中,怎么做呢?只将Pipeline的实现换成"FilePipeline"就可以了

1 | /** |

2.3 爬虫的配置、启动和终止

Spider

Spider是爬虫启动的入口。在启动爬虫之前,我们需要使用一个PageProcessor创建一个 Spider对象,然后使用run()进行启动。

同时Spider的其他组件(Downloader、Scheduler、Pipeline)都可以通过set方法来进行设置。

| 方法 | 说明 | 示例 |

|---|---|---|

| create(PageProcessor) | 创建Spider | Spider.create(new GithubRepoProcessor()) |

| addUrl(String…) | 添加初始的URL | spider .addUrl(“http://webmagic.io/docs/") |

| thread(n) | 开启n个线程 | spider.thread(5) |

| run() | 启动,会阻塞当前线程执行 | spider.run() |

| start()/runAsync() | 异步启动,当前线程继续执行 | spider.start() |

| stop() | 停止爬虫 | spider.stop() |

| addPipeline(Pipeline) | 添加一个Pipeline,一个Spider可以有多个Pipeline | spider .addPipeline(new ConsolePipeline()) |

| setScheduler(Scheduler) | 设置Scheduler,一个Spider只能有个一个Scheduler | spider.setScheduler(new RedisScheduler()) |

| setDownloader(Downloader) | 设置Downloader,一个Spider只能有个一个Downloader | spider .setDownloader(new SeleniumDownloader()) |

| get(String) | 同步调用,并直接取得结果 | ResultItems result = spider.get(“http://webmagic.io/docs/") |

| getAll(String…) | 同步调用,并直接取得一堆结果 | List results = spider .getAll(“http://webmagic.io/docs/", “http://webmagic.io/xxx") |

Site

Site.me()可以对爬虫进行一些配置配置,包括编码、抓取间隔、超时时间、重试次数等。在这里我们可以先简单设置一下:重试次数为3次,抓取间隔为一秒。

1 | package cn.itbuild.webmagic.test; |

站点本身的一些配置信息,例如编码、HTTP头、超时时间、重试策略等、代理等,都可以通过设置Site对象来进行配置。

| 方法 | 说明 | 示例 |

|---|---|---|

| setCharset(String) | 设置编码 | site.setCharset("utf-8") |

| setUserAgent(String) | 设置UserAgent | site.setUserAgent("Spider") |

| setTimeOut(int) | 设置超时时间,单位是毫秒 | site.setTimeOut(3000) |

| setRetryTimes(int) | 设置重试次数 | site.setRetryTimes(3) |

| setCycleRetryTimes(int) | 设置循环重试次数 | site.setCycleRetryTimes(3) |

| addCookie(String,String) | 添加一条cookie | site.addCookie("dotcomt_user","code4craft") |

| setDomain(String) | 设置域名,需设置域名后,addCookie才可生效 | site.setDomain("github.com") |

| addHeader(String,String) | 添加一条addHeader | site.addHeader(“Referer”,”https://github.com“) |

| setHttpProxy(HttpHost) | 设置Http代理 |

site.setHttpProxy(new HttpHost("127.0.0.1",8080)) |

3. 爬虫分类

网络爬虫按照系统结构和实现技术,大致可以分为以下几种类型:通用网络爬虫、聚焦网络爬虫、增量式网络爬虫、深层网络爬虫。 实际的网络爬虫系统通常是几种爬虫技术相结合实现的。

3.1 通用网络爬虫

通用网络爬虫又称全网爬虫(Scalable Web Crawler),爬行对象从一些种子 URL 扩充到整个 Web,主要为门户站点搜索引擎和大型 Web 服务提供商采集数据。

这类网络爬虫的爬行范围和数量巨大,对于爬行速度和存储空间要求较高,对于爬行页面的顺序要求相对较低,同时由于待刷新的页面太多,通常采用并行工作方式,但需要较长时间才能刷新一次页面。

简单的说就是互联网上抓取所有数据。

3.2 聚焦网络爬虫

聚焦网络爬虫(Focused Crawler),又称主题网络爬虫(Topical Crawler),是指选择性地爬行那些与预先定义好的主题相关页面的网络爬虫。

和通用网络爬虫相比,聚焦爬虫只需要爬行与主题相关的页面,极大地节省了硬件和网络资源,保存的页面也由于数量少而更新快,还可以很好地满足一些特定人群对特定领域信息的需求 。

简单的说就是互联网上只抓取某一种数据。

3.3 增量式网络爬虫

增量式网络爬虫(Incremental Web Crawler)是 指 对 已 下 载 网 页 采 取 增量式更新和只爬行新产生的或者已经发生变化网页的爬虫,它能够在一定程度上保证所爬行的页面是尽可能新的页面。

和周期性爬行和刷新页面的网络爬虫相比,增量式爬虫只会在需要的时候爬行新产生或发生更新的页面 ,并不重新下载没有发生变化的页面,可有效减少数据下载量,及时更新已爬行的网页,减小时间和空间上的耗费,但是增加了爬行算法的复杂度和实现难度。

简单的说就是互联网上只抓取刚刚更新的数据。

3.4 Deep Web 爬虫☆

Web 页面按存在方式可以分为表层网页(Surface Web)和深层网页(Deep Web,也称 Invisible Web Pages 或 Hidden Web)。

表层网页是指传统搜索引擎可以索引的页面,以超链接可以到达的静态网页为主构成的 Web 页面。

Deep Web 是那些大部分内容不能通过静态链接获取的、隐藏在搜索表单后的,只有用户提交一些关键词或者登陆后才能获得的 Web 页面。